AIを使うこと自体は、もうほとんどの会社で当たり前になった。社員がChatGPTを開いていても誰も驚かない。でも、自分のところに来る相談で一番多いのは、実は「これで合ってるのかな」というやつだ。「とりあえず入れてみた」「使ってる社員もいる」「なんとなく便利」。そこから一歩進んで「安全に使えてるか」を確認している会社は、まだ少ない。今回はAI組織化シリーズの番外編として、その「今更聞けない」を解消するための基礎を書きます。新入社員に教える前提でも読めるように、用語は最小限で。

1. リテラシーなしで使うと、何が起きるか

具体的に何が困るのか、実際に相談を受けたり、自分でもヒヤッとした失敗パターンを3つ書きます。

失敗1:顧客名簿をそのままAIに貼り付けてしまう

「メルマガ用に整理してほしい」と言って、顧客リストをまるごとChatGPTに貼り付ける。その場では便利に動いてくれる。でも後から「あれ、個人情報、AIに渡しちゃったかも…」と気づく。これは想像以上によくある話だ。個人プランの多くは、入力データがAIの学習に使われる可能性がある(後述)。社内で使ってる社員一人がやってしまうだけで、企業の信頼問題に直結する。

失敗2:AIの出力をそのまま提案書に貼り付ける

顧客向け資料をAIに書かせて、そのまま提出。後で顧客から「この数字、出典どこですか?」と聞かれて答えられない。AIは「ハルシネーション」と呼ばれる、もっともらしい誤情報を堂々と生成する性質がある。固有名詞・統計データ・引用は、特に間違っていることが多い。生成物の確認なしに業務利用すると、信用が一気に削れる。

失敗3:無料プランで業務情報を扱う

「とりあえず無料で試してる」だけのつもりが、いつの間にか毎日業務で使うようになる。便利だから歯止めがかからない。でも無料プランの規約を読んだことがある人は少ない。気づかないうちに会社の情報が学習データとして使われている、というのは2026年でも普通に起きる話だ。

共通しているのは、「便利だから使ってしまう」スピードに対して、「使い方のルール」を整える側が追いついていない、ということ。これは個人の責任というより、会社としてリテラシー教育の機会を持てていない問題のほうが大きい。

2. 渡してOK/NGの判断基準

一番シンプルな判断軸は、これ一つだ。

「この情報、外に公開されても困らないか?」

困らないならOK、困るならNG。実はこれだけで7〜8割の判断はつく。具体例を挙げます。

✅ 渡してOK

- 自分で書いた下書き・メモ

- 業界の一般的な質問・調べ物

- プレスリリース等の公開情報

- 自分名義の生成物(自分のブログ案など)

- 仮名・ダミーデータでの相談

❌ 渡してNG

- 顧客の個人情報(氏名・住所・電話・メール)

- 契約書・請求書・見積書の原本

- 社内パスワード・APIキー・認証情報

- 未公開の財務・人事情報

- 取引先との機密合意事項

悩むのは、グレーゾーンの情報だ。「社員の名前は?」「自社の売上は?」「特定の顧客向け企画書は?」。このあたりは「他人に見せても問題ない情報か」をもう一段考える。判断に迷ったら、入れない、が安全側のルールになる。グレーで止めて上司に確認するルートを社内で用意しておくと、現場が動きやすくなる。

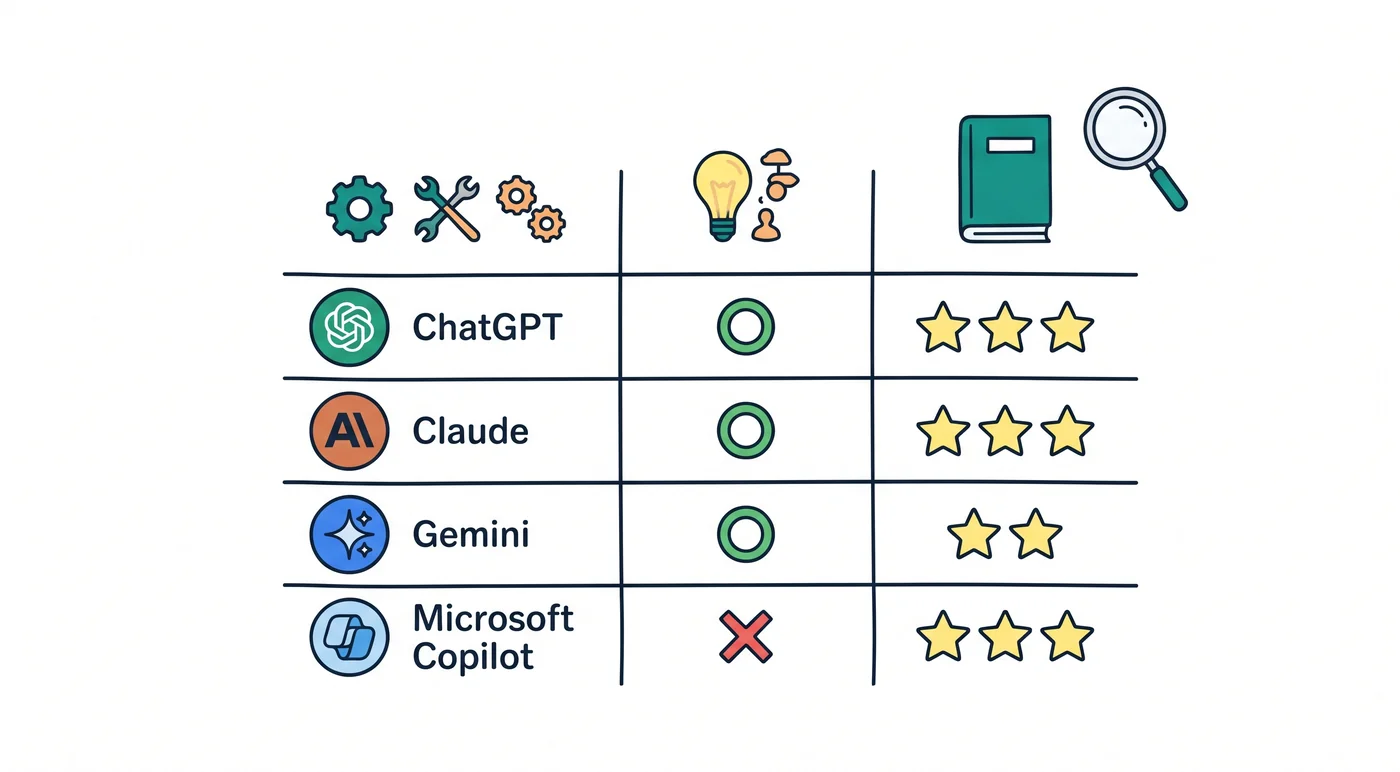

3. 学習に使われるツール、使われないツール(2026年5月時点)

AIに入力したデータが「そのAIの学習材料に使われるかどうか」は、ツールとプランによってまったく違う。これを知らずに使っているのが、一番のリスク源だ。

主要サービスを表にまとめます。2026年5月時点の情報で、各社のポリシーは頻繁に変わるので、導入前に必ず公式ドキュメントで最新版を確認してください。

| サービス | 個人プラン | ビジネス/法人プラン |

|---|---|---|

| ChatGPT(OpenAI) | 学習に使われる ※「設定 → データコントロール → モデル改善のためにデータを使用」をオフでオプトアウト可 |

学習に使われない Business / Enterprise / Edu |

| Claude(Anthropic) | 学習に使われる claude.ai 個人プラン(Free / Pro / Max)はデフォルト学習対象。アカウント設定 → プライバシーでオプトアウト可 |

学習に使われない Claude API / Claude Code(入出力は7日後自動削除)、Team / Enterprise |

| Gemini(Google) | 学習に使われる 無料・Advanced 共。「Gemini アプリのアクティビティ」設定で停止可 |

学習に使われない Google Workspace 有料プラン内の Gemini Business / Enterprise |

| Microsoft Copilot | 公式に明記なし 2026年5月時点で個人プランの学習利用について公式に明確記載なし。利用前に最新規約を要確認 |

学習に使われない Microsoft 365 Copilot(法人 / Enterprise Data Protection 適用時) |

※ 上記は2026年5月時点の各社公開情報をもとにした概要です。各社の規約・プライバシーポリシーは更新されるため、業務利用前に必ず最新版を公式サイトで確認してください。表中の「学習に使われない」はベンダー側の公式説明にもとづくものですが、運用上は社内ルールでも入力情報の最終判断をしてください。

結論はシンプルで、業務利用なら有料の法人プランかEnterprise契約が事実上必須になる。月数千円から1万円台のコストで、情報漏洩リスクを大幅に下げられる。うちでもClaude API経由とChatGPT Teamを併用していて、業務情報を入れていいツールと、雑談・調べ物にしか使わないツールを分けています。

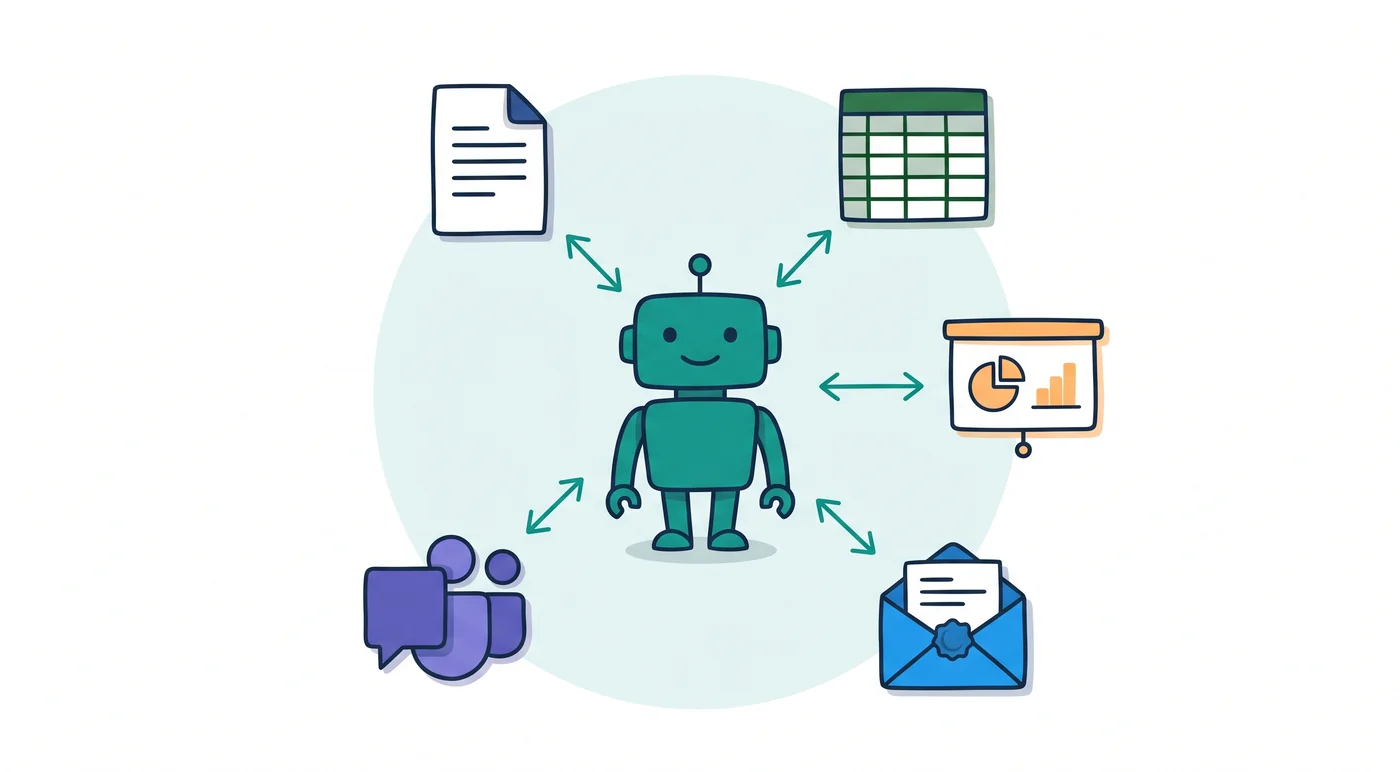

4. コラム — AIがオフィスソフトの中に来た(Claude × Microsoft 365 連携)

2026年に入ってから、AIとオフィスソフトの距離が一気に縮まりました。なかでも自分が一番大きな変化だと思っているのが、Claude(Anthropic)と Microsoft 365 の本格連携です。Word・Excel・PowerPoint の中で Claude をサイドバーとして呼び出せるようになり、Outlook 連携もパブリックベータとして使えるようになっています(2026年5月時点)。

連携の形は大きく2種類あります。「使ってる感」が結構違うので、ここはちゃんと区別したほうがいいです。

①Microsoft 365 コネクタ(Claude.ai 側からアクセス)

Claude.ai の会話画面から、SharePoint・OneDrive・Outlook・Teams のデータを検索・参照できる仕組みです。「先週の Teams 会議で出た議題を要約して」「OneDrive 内のあの資料、関連箇所を抜き出して」というような使い方ができます。Free 含む全プランで設定可能ですが、Free は機能制限があります。

②Claude for Microsoft 365 アドイン(Office 内サイドバー)

Word・Excel・PowerPoint・Outlook の画面右側に Claude が常駐するタイプです。Excel ではセル内容への質問や数式の修正、Word では変更履歴付きの下書き・レビュー、PowerPoint ではテンプレートに沿ったスライド生成、Outlook(ベータ)ではメール仕分けや返信ドラフトといった用途が想定されています。こちらは Claude 有料プランが必須で、Microsoft 365 側でも職務用アカウント+Microsoft Entra テナント管理者の承認が必要です(個人 outlook.com アカウントは非対応)。

リテラシー観点での注意点

業務で使うなら、必ず確認しておきたいポイントが3つあります。

- Claude の Team / Enterprise プランはデフォルトで顧客データを学習に使わないことが、Anthropic 公式で明示されています。

- 一方、個人 Pro プランで M365 連携を使う場合は、claude.ai 側のプライバシー設定次第。業務利用前に必ず確認してください。

- 2026年1月に Anthropic が Microsoft のサブプロセッサーとして登録されたため、Microsoft 365 経由の利用には Microsoft 製品の利用規約・データ処理補遺(DPA)の保護も適用されます。

もうひとつ、現時点では SharePoint のサイト別の権限絞り込みには対応しておらず、連携対象がテナント全体になる仕様です。社内の機密情報の置き場所を整理してから導入するのが安全です。「全部読める前提」で運用設計を組むイメージです。

「AIが社員のように Office の中で動く」感覚は、新しい体験です。慣れていない人ほど価値を感じやすい一方で、いきなり全社展開すると情報の流れが見えにくくなります。まずは経営者・管理職だけで試してから、段階的に部署単位で広げるのが現実的だと思っています。

5. 新入社員に最初に教える、3つのルール

社内研修やリテラシーセミナーで実際に使っている、3点セットです。これだけ徹底できれば、よくあるトラブルの大半は防げます。

RULE 01

個人情報・顧客情報は

絶対に入れない

顧客名・取引先・社員の個人情報は一切AIに渡さない。必要なら仮名や代名詞でやり取りする。「ちょっとだけなら」が一番危ない。

RULE 02

出力は必ず

ダブルチェック

AIが出した文章・数字・固有名詞は必ず自分で確認する。AIは「もっともらしい誤情報」を堂々と書く。下書きとして使い、最終判断は人間が行う。

RULE 03

業務利用は

有料プラン以上

無料プランで業務情報を扱わない。会社が契約した有料・Enterpriseアカウントだけを業務に使う。個人アカウント業務利用は禁止。

あわせて、用途別のおすすめツールも軽くまとめておきます。これは「正解」ではなく、2026年5月時点で自分が新入社員に薦めるとしたら、という目安です。

- 文章作成・要約・アイデア出し:ChatGPT / Claude

- 画像生成:Gemini Nano Banana / DALL-E

- コード・自動化:Claude Code / Cursor / GitHub Copilot

- 調査・検索:Perplexity / Genspark / ChatGPT Search

- 業務統合(資料・メール・カレンダー):Microsoft 365 Copilot / Google Workspace Gemini / Notion AI

全部を使う必要はない。最初は1〜2ツールに絞って、社員全員が同じものを使えるようにするほうが、教育コストも事故リスクも下がる。

6. うちで、お手伝いできること

「自社だけで判断するのが不安」「社内全員にきちんと教えたい」「ガイドラインを作りたい」という方向けに、FlatWorksでサポートしています。三重県志摩市拠点で、伊勢志摩・東海3県(愛知・岐阜・三重)中心、全国オンライン対応です。実例ベースで、すぐ動ける形でお渡しします。

リテラシーは、知っているだけで防げる事故が多い領域です。逆に、知らないまま使い続けると、いつかどこかで必ず一度はヒヤッとする。先に整備しておいたほうが、AI活用の効果も10倍くらい変わってきます。

新入社員教育のタイミング、新年度のスタート、社内ルールを見直す節目など、きっかけはなんでもOKです。お気軽にご相談ください。

よくある質問

AIに渡してはいけない情報って何ですか?

顧客の個人情報(氏名・住所・電話・メール)、契約書や請求書の原本、社内のパスワード・APIキー・認証情報、未公開の財務情報や人事情報、取引先との機密合意事項などは原則として渡さないでください。判断の基準はシンプルで「この情報、外部に公開されても困らないか?」と自問することです。困るならAIには渡さない、が安全側のルールです。グレーゾーンの情報も多いので、迷ったら入れない判断をおすすめします。

ChatGPTの無料プランは仕事で使っていい?

業務情報を扱う用途では推奨しません。2026年5月時点のChatGPT個人プラン(Free/Plus/Pro)はデフォルトで入力データがモデル学習に使われる設定で、オプトアウト操作をしない限り会社の情報が学習材料になる可能性があります。業務利用ならChatGPT Business/Enterprise、Claude API / Claude Code(入出力は7日後自動削除)、Google Workspace有料プランのGeminiなど、学習対象外を明示しているプランを契約することが事実上の前提になります。なお、claude.ai の個人プラン(Free/Pro/Max)も2026年からデフォルトで学習対象になっているため、個人プランでの業務利用は同様に注意が必要です。月数千円のコストで情報漏洩リスクを大幅に下げられます。

AIの出力って信用していい?

鵜呑みは危険です。AIには「ハルシネーション」と呼ばれる、もっともらしい誤情報を堂々と生成する性質があります。特に固有名詞・数値・引用・統計データは間違っていることがよくあります。AIの出力は「下書き」として受け取り、最終的な事実確認は必ず人間が行う運用が安全です。FlatWorksでは「AIが書いた数字・固有名詞は必ず一次ソースで裏取り」をルール化しています。

社員にAIの使い方をどう教えればいい?

新入社員にまず教える3つのルールを推奨しています。(1)個人情報・顧客情報は絶対に入れない、(2)出力は必ずダブルチェック、(3)業務利用は会社契約の有料プラン・Enterpriseアカウントだけを使う。この3点を社内研修で徹底するだけで、よくあるトラブルの大半は防げます。あわせて「迷ったら上司に確認」のルートを用意しておくと安心です。

Claude が Microsoft 365 と連携できるって本当?

本当です。2026年5月時点で、Word・Excel・PowerPoint の中で Claude をサイドバーとして呼び出せるアドイン(Outlook はパブリックベータ)と、Claude.ai 側から SharePoint・OneDrive・Outlook・Teams のデータを参照できる Microsoft 365 コネクタの2種類が提供されています。アドイン利用には Claude 有料プランが必須で、Microsoft 365 側では職務用アカウントと Microsoft Entra テナント管理者の承認が必要です。Team / Enterprise プランではデフォルトで顧客データが学習に使われない保護が適用されますが、個人 Pro プランで業務利用する場合は claude.ai 側のプライバシー設定をご確認ください。現時点では SharePoint のサイト別権限絞り込みには非対応で、連携対象がテナント全体になる点にもご注意ください。

うちの会社、まず何から始めればいい?

推奨は4週間ロードマップです。1週目:経営者が個人プランを契約してさわってみる。2-3週目:自社の「禁止情報リスト」と「使用許可ツール一覧」を作る。4週目以降:チーム展開と業務適用。3ヶ月後:正式な社内ガイドライン化。最初から完璧を目指さず、運用しながらルールを育てていく形が現実的です。FlatWorks自身も同じ流れで運用しています。

ガイドラインって作った方がいい?

社員数2-3名以上で業務にAIを使うなら、ガイドラインは作っておいたほうが安全です。「何を渡してOKか」「どのツールを使うか」「誰が承認するか」を1〜2ページにまとめるだけでも、社員の判断を揃えられて事故を減らせます。完璧を目指す必要はなく、最初は最小限のルールから始めて、運用しながら追記していく形で十分機能します。FlatWorksでは社内ガイドライン作成代行のサービスもご用意しています。

第2回「どのルールファイルを書いたら劇的に変わったか――実際のファイル構造と設計の考え方」

特集記事「AIコーディングツール比較 2026年4月版 — Claude Code / ChatGPT / Copilot / Cursor / Gemini / Codex」

※ 本記事の各AIサービスの学習データ取扱いに関する記述は2026年5月時点の各社公開情報にもとづくものです。主な出典は次の通り: OpenAI: How your data is used to improve model performance、 OpenAI Enterprise Privacy、 Anthropic Privacy Policy、 Anthropic Privacy Center — Is my data used for model training?、 Google: Gemini Apps Privacy Hub、 Google Workspace with Gemini FAQ、 Microsoft 365 Copilot エンタープライズ データ保護、 Anthropic: Claude for Microsoft 365、 Anthropic Help Center: Microsoft 365 Connector、 Microsoft Learn: Claude in Azure Foundry Data Privacy。 ポリシーは予告なく変更されることがあるため、業務での導入・運用にあたっては必ず各社の最新の公式ドキュメント・利用規約・プライバシーポリシーをご確認ください。なお、日本国内では2026年4月7日に「個人情報の保護に関する法律等の一部を改正する法律案」が閣議決定されており(国会審議中・未施行)、AI開発における個人データ利用に関する制度改正の動きがあります(出典: 個人情報保護委員会プレスリリース)。 本記事の情報は判断材料の一つとしてご活用いただくもので、特定のツールの導入を保証・推奨するものではありません。